多くの企業で生成AIのビジネス利用が進んでいる。社内文書をLLM(大規模言語モデル)に与えて回答を生成させるRAG(Retrieved-Augmented-Generation)の実装が一般化し、2025年に入ってからはOpen AI社がdeep researchをリリースするなど、AIエージェントの導入検討も始まっている。最先端のAIを気軽に使えるようになった一方、リスクも顕在化してきた。例えば社内の機密文書を生成AIにアップロードしてしまう、生成AIで構築したチャットボットが法律違反を推奨してしまうなどのインシデントが発生している。

AIの利活用が本格化する中、AI規制に関する議論が世界各国で盛んになっている。世界に先駆けてAI規制に乗り出したEUでは、2024年8月1日に欧州(EU)AI規制法を施行した。EU域内に所在していない企業であっても、EU域内でAIシステムを提供する場合は、当法案に準拠する必要があり、違反した場合には最大3500万ユーロまたは全世界売上高の7%の高い方を上限とした非常に高額な罰金が設定されている。

G7は生成AIの開発企業などにAIのリスクなどを報告させる枠組みを2025年2月から運用開始予定である。AIのぜい弱性などのリスク管理やセキュリティ対策、安全性の向上やリスクの軽減に向けた研究や投資の内容など、7つの項目について報告を求め、OECDのWebサイトに報告内容や回答企業について公表する。

その他、2024年12月に韓国でもAI基本法が制定されている。

日本においては、2024年4月に経済産業省と総務省から「AI事業者ガイドライン」が公表され、2025年3月に第1.1版が公表されるなど継続的に更新されている。2025年3月時点では、内閣府のAI戦略会議・AI制度研究会の取りまとめを基に、「AI関連技術の研究開発・活用推進法案」の法整備化が検討され、閣議決定の後に通常国会へ提出されている。政府内に司令塔機関を設置し、企業は国による調査への協力・情報提供義務が明文化・悪質な事業者名の公表などが盛り込まれる方向で検討されている。

生成AIが広く一般に普及したことにより規制当局だけでなく、市民からの監視の目も強まっている。2024年10月には声優有志が「NOMORE無断生成AI」キャンペーンを実施し、無断で声優の声を学習し生成されたAI生成物についての問題提起を行っている。

このように、各国当局や社会からAIの適切な使い方に対する関心は高まっており、AI開発企業だけでなくAIを利用する企業も顕在化するリスクへの対応が迫られていることから、AIガバナンスの実現は喫緊の課題となっている。

「生成AIが切り拓くビジネス革命 ~驚きの成果を生む4つの成功ポイント~」第二回 進む法規制と求められるAIガバナンス対応

- テクノロジー・トランスフォーメーション

- クラウド

- AI

生成AI活用に潜むリスク

生成AIは、知的財産の侵害、偽情報・誤情報の生成・発信など、従来のAIでは存在しなかった新たな社会的リスクが潜んでおり、ステークホルダーごとに対応すべき課題は異なる。ここでは経営層・業務部門・デジタル/IT部門・法務部門4つの視点から一例を以下に示す。

-

経営層

経営戦略や各種ガバナンス戦略との整合を考慮し、生成AIの利用が社会に与える影響の把握やデータ漏洩、誤った意思決定などを起こさないための枠組みの構築や発信が必要となる。AIガバナンスの国内外の動向や生成AI利用の倫理的妥当性を把握し、自社におけるAIポリシー策定などが課題となりうる。グループ企業を含め、AIガバナンスを担当する経営層や担当部門を定め、有事の際にグループ企業とも連携して対応できる体制を整備する必要がある。 -

業務部門

従業員が正しく生成AIを利用し、業務の効率化を図るための支援や、生成AIが出力する結果を正しく検証できるような仕組みとして、AI利用ルールや開発ガイドライン、チェックリストの策定が課題となる。また、ハルシネーション*の理解、著作権侵害に関する理解、日々アップデートされる新たな生成AIモデルを活用するスキル習得などの従業員教育も課題となる。

*人工知能によって生成された、虚偽または誤解を招く情報を事実かのように提示する応答のこと -

デジタル/IT部門

セキュリティとセイフティ(安全性、倫理、説明責任)の両面からAIガバナンス対策の実行性を担保することが課題となる。現場で想定通りの使い方がなされているのか一括して管理し、自社内のAIモデル・サービスのレジストリを整理することで、網羅的に把握している状態が望ましい。また、プロンプトインジェクション*などの対策も必要となる。日々アップデートされる新たな生成AIツールの特性を踏まえた導入可否判断や、導入に当たっての各部門へのわかりやすい説明の実施が課題となりうる。

*機械学習モデル、特に大規模言語モデル(LLM)を悪用する攻撃手法の一つ -

法務部門

生成AIの利用が各種法規制(データ保護法、著作権法、個人情報保護法など)に適合しているか、また生成AIの導入に伴う契約(ライセンス契約やデータ共有契約など)を適切に管理し、法的リスクを抑えることが重要となる。現場のAI利用者にリスクを認知させ、リスクをチェックする仕組みの構築・普及させることが課題となりうる。

企業に求められるAIガバナンス

生成AIのリスクを適切にコントロールしながらAIを効果的に利用するためのAIポリシー及びルールの策定、それを実現するための組織体制の構築が不可欠となる。総務省、経済産業省から公表されている「AI事業者ガイドライン」においても、ルールや手続きが固定されたAIガバナンスではなく、社会の変化に応じて継続的にサイクルをアップデートさせていくアジャイルガバナンスを推奨している。

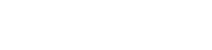

アビームコンサルティングでは、アジャイルガバナンスに対応したAIガバナンス実現に向け、アセスメント・戦略策定・実現の3つのフェーズを定義し、実現フェーズでは組織・人材・システム・業務の4つの観点でAIガバナンス体制強化の支援を行っている。

図1:AIガバナンス構築に向けたサービスマップ

図1:AIガバナンス構築に向けたサービスマップ

-

アセスメントフェーズ

組織における現状のAIガバナンス構築状況を正確に把握するため、運用状況も含めたアセスメントを行う。組織において既に生成AIを導入している場合は、どのようなユースケースで利用されているか、把握している課題やリスクはどのようなものがあるか洗い出す。

自社で使用しているAIシステム、使用しているデータや契約形態、システムの利用者などにより企業に求められるAIガバナンスのレベルは変わるため、正確に実情を把握することが重要となる。 -

戦略策定フェーズ

アセスメントフェーズにて把握した現状を踏まえ、AIガバナンス戦略策定に必要な調査(研究動向、法規制、他社事例)を行い、AI倫理方針策定、倫理リスク分析やAIガバナンス戦略(ロードマップ、投資対効果)の策定を行う。特に生成AIに関しては、倫理的ガイドラインの策定をするとともに、ステークホルダーへの公表方法の検討、SDGsや他の経営戦略との整合性を確保した戦略を策定することが重要となる。 -

実現フェーズ

実現フェーズにおいては、戦略策定フェーズで策定した戦略を元に組織・人材・システム・業務の4観点で組織のAIガバナンス構築を実現する。特に生成AIでのガバナンスを実現するにあたっては、出力が予測できないことから、継続的なモニタリングと組織体制整備が重要なポイントとなる。-

A)

組織観点

組織図や職務分掌を定義し、目指すべきAIガバナンス体制を実現可能な組織体制の整備を行う。

特に、生成AIやAIエージェントを用いて外部顧客にサービスを提供する場合には、出力結果をコントロールすることが従来のAIと比較して困難であることから、業務部門だけでなく法務部やIT部門など包括的にリスクを管理するような組織設計を行うことが重要となる。 -

B)

人材観点

AIガバナンスを遵守するための人材スキルセットの定義や現状スキルの定量化、目指すべき人材要件の定義を行う。また、人材育成モデルを定義し、トレーニングコンテンツの設計や継続的な人材育成を行うための仕組みを策定する。

特に、AIシステムにおける個人情報や知的財産の取り扱いについては最新の法解釈の動向を踏まえて、社員に対するトレーニングを実施することが望ましい。 -

C)

システム観点

AIシステムの要件定義、システム導入におけるベンダー選定やツールの導入を行う。また、AIシステムを利用するエンドユーザーの教育などを行う。

自社のAIシステムの特徴を踏まえ、どのようなリスクを考慮する必要があるのか、そのリスクを管理するにあたり最適なAIガバナンスソリューションは何かを検討する。 -

D)

業務観点

AIプロジェクトの標準化支援やAI利活用チェックリスト作成、AIプロジェクトの実施支援(リスク分析、モデル構築、モデル運用)を行う。

AIシステムは運用するにあたり出力品質の低下や新たな手法による攻撃といった問題に直面することがあるので、導入時にガバナンス検討を行うだけでなく、継続的に検討を実施するような運用を構築することが、AIガバナンス構築の鍵となる。

-

アセスメント・戦略策定・実現の3フェーズで組織のAIガバナンス体制を網羅的に構築するとともに、AIガバナンス全体のルールや運用サイクルを構築し、社会環境に応じてアップデートされるアジャイルガバナンスの実現を目指す。

生成AIのみならず、AIエージェント(タスクを自律的に実行可能なAI)の企業への普及も今後予想され、AIに入力する情報やAIが生み出す情報以外にも、AI自体が実行するタスク(意思決定や外部環境との自動連携など)についてもリスク管理が必要となる。

AIガバナンスを確立した未来

これらの施策を実施することで、生成AIに関するリスクやそのリスクに対応するために必要となる組織・ルール・システムについて各企業は把握可能である。そのリスクが自社にとって受容可能なのかを検討し、リスク対策を事前に講じることでリスクを適切な水準に管理しながら、生成AIのメリットを最大限生かし活用を推進することができる。結果的に、AIガバナンスに対応することは企業にとってコストにならず、将来的なリスクの軽減やブランド価値の向上に繋がり企業の収益ドライバーになっていくと考える。AIガバナンスの構築はAI利活用と一体化して考えるべき戦略的なアジェンダとして位置づけていくべきだろう。

インサイト

- 「生成AIが切り拓くビジネス革命 ~驚きの成果を生む4つの成功ポイント~」 第一回 生成AIがもたらすビジネス革命

- 「生成AIが切り拓くビジネス革命 ~驚きの成果を生む4つの成功ポイント~」第二回 進む法規制と求められるAIガバナンス対応

相談やお問い合わせはこちらへ